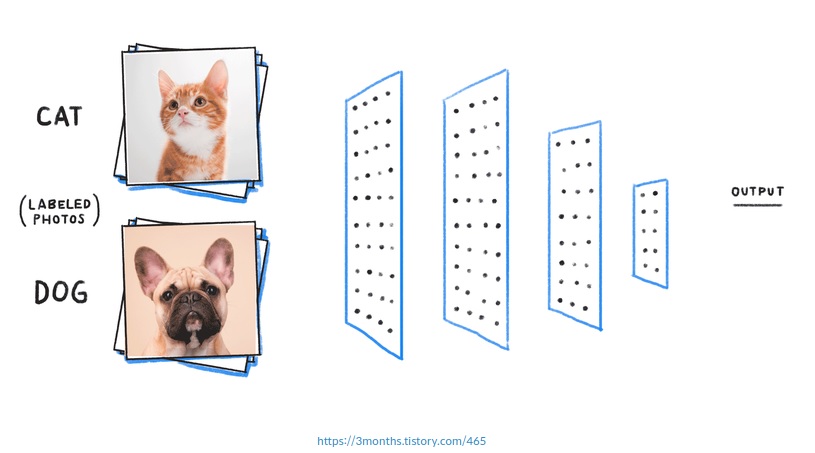

1. 들어가며 - 지금까지 딥러닝 모델을 기반으로 이미지를 분류, 탐지하는 여러 가지 모델을 공부해 왔다. - 이미지를 모델의 입력에 맞게 전처리해주고 모델에 통과시킨 뒤 결과를 해석해서 추론값을 얻어내는 과정이 익숙하다. - 그런데 모델이 잘 동작한다는 것을 확인하고 끝내기에는 궁금한 것이 많다. - 예를 들어 개와 고양이를 분류하는 딥러닝 모델을 만들었다고 하자. - 이 모델이 이미지의 어느 부분을 보고 개라는 결론을 내렸는지 알 수 있을까? - 그동안 우리가 다룬 딥러닝은 모델의 추론 근거를 알 수 없는 블랙박스(Black Box) 모델이였다. - 그래서 이 모델을 신뢰할 수 있는지조차 명확하지 않았따. - 이번에는 모델과 추론의 신뢰성에 대한 답을 찾는 XAI(Explainable Artifici..